KI | KI und Mensch

Anwendungen und Systeme mit KI-Funktionalitäten sind mittlerweile in unserem Alltag angekommen. Doch wie beeinflusst dieses Zusammenleben von Mensch und KI unser Denken, Fühlen und Handeln – und wo liegen Chancen und Risiken? Der Beitrag beantwortet nicht nur diese und andere Fragen, sondern geht auch auf Möglichkeiten ein, das Thema im Unterricht zu behandeln.

Alltag mit KI-Systemen

Anwendungen oder Systeme mit KI-Funktionalitäten wie Chatbots und KI-Assistenten sind niedrigschwellig zugänglich. Sie sind im Alltag der Menschen angekommen - verbunden mit Chancen und Risiken.

Chancen ergeben sich beispielsweise durch einen verbesserten und personalisierten Zugang zu Wissen, durch Entlastung bei Routineaufgaben, durch mögliche Verbesserung der Barrierefreiheit und ggf. verbesserte Dienstleistungen.

Gleichzeitig darf man die Risiken nicht unterschätzen, die etwa durch Deepfakes und Verzerrungen, Diskriminierung, gezielte Manipulation und Desinformation, Hass und Hetze oder durch ein übersteigertes Vertrauen in KI-Anwendungen entstehen.

KI-Systeme können menschlich wirken, sind es aber nicht - der Eliza-Effekt

Immer mehr Menschen nutzen KI-Systeme bzw. Systeme mit KI-Funktionalität ganz selbstverständlich in ihrem Alltag – zum Unterhalten, Fragen stellen, Lernen, Informieren und Probleme lösen.

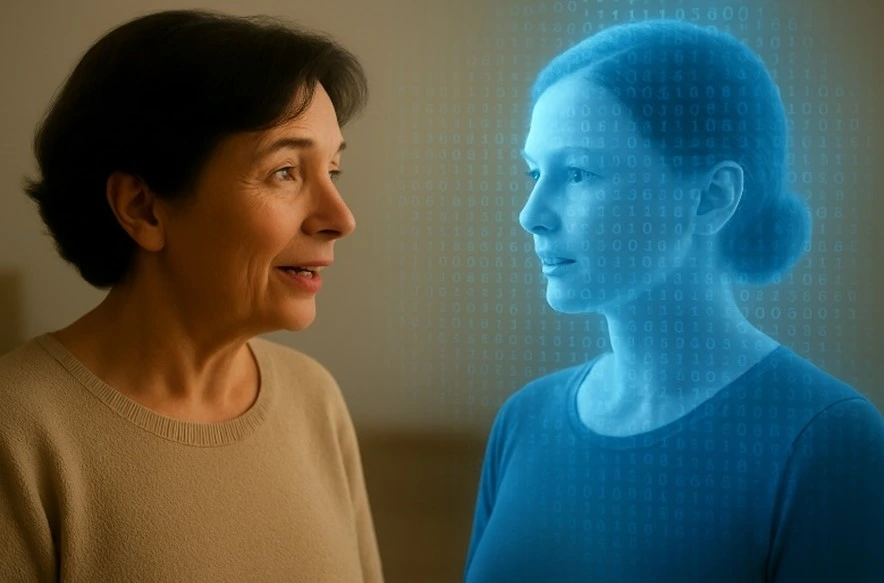

In der Interaktion mit solchen Systemen verschwimmt manchmal das Bewusstsein, dass man sich nicht mit einem Menschen, sondern mit einer Maschine unterhält. Dem KI-System werden menschliche Eigenschaften wie Einfühlungsvermögen, Empathie und Mitgefühl zugeschrieben, was zur Folge hat, dass sich manche Nutzerinnen und Nutzer dem System auch emotional anvertrauen.

Einem KI-System menschliche Eigenschaften zuzuschreiben ist ein Phänomen, das schon vor Jahrzehnten beobachtet wurde. Man spricht hier vom Eliza-Effekt. Dieser kann dazu führen, dass Menschen dem Chatbot persönliche Geheimnisse anvertrauen oder seinem möglicherweise widersinnigen Rat folgen. Doch woher der Name „Eliza-Effekt“?

Den ersten Chatbot entwickelte der deutsch-amerikanische Informatiker Joseph Weizenbaum (1923-2008) bereits im Jahr 1966 zu Forschungszwecken. Mit ELIZA wollte er untersuchen, wie gut die Kommunikation zwischen Mensch und Computer in natürlicher Sprache funktionieren kann. Der Chatbot wurde dabei so gestaltet, dass er einen Psychotherapeuten simulierte, der auf die Benutzereingaben mithilfe einfacher Regeln reagierte. So konnte der Chatbot etwa auf die menschliche Aussage „Ich habe eine lange Bootsfahrt gemacht“ mit „Erzählen Sie mir mehr über Boote“ antworten, wodurch die Unterhaltung glaubwürdig wirken sollte. Weizenbaum war vor allem überrascht, wie leicht sich Menschen täuschen ließen. Er berichtete: „Some subjects have been very hard to convince that ELIZA (with its present script) is not human“ (Weizenbaum, 1966, S. 42).

Übermäßiges Vertrauen in KI-Systeme ist kritisch zu sehen, weil Menschen dann maschinengenerierten Ratschlägen folgen, die potenziell fehlerhaft, verzerrt oder intransparent sind und realen Schaden verursachen können.

„Die Gefahr der künstlichen Intelligenz liegt nicht darin, dass Maschinen mehr und mehr wie Menschen denken, sondern dass Menschen mehr und mehr wie Maschinen denken.“

Systematische Verzerrungen / Bias

In diesem Zusammenhang ist der Automationsbias, ein bekannter psychologischer Effekt, bedeutsam: „Hierbei entwickeln Menschen ein übermäßiges Vertrauen in automatisierte Prozesse, welches in einem unkritischen Umgang mit automatisierter Entscheidungsfindung resultieren kann. Im Extremfall übernehmen Menschen Ausgaben und Ansichten von Maschinen, selbst wenn diese der eigenen Expertise widersprechen und offensichtlich falsch bzw. unglaubwürdig sind (…).“ (BSI, 2025, S. 11 f)

Doch es gibt noch weitere Ursachen für Fehler - teils technischer, teils psychologischer Natur - die im Kontext der Nutzung eines KI-Systems von Bedeutung sind. Exemplarische werden nachfolgende genannt:

Datenbias: Ein Oberbegriff, mit dem verschiedene Arten von Bias im Kontext der Datenerhebung zusammengefasst werden. Hierunter fallen Bias, die zustande kommen, wenn Daten veraltet sind, wenn es eine Schieflage bei der zugrunde liegenden Verteilung der Daten gibt, wenn wichtige Merkmale bei der Erfassung der Daten nicht berücksichtigt werden oder aus anderen Gründen in den resultierenden Datensätzen fehlen. (BSI, 2025, S. 11 f)

Algorithmischer Bias (Bias Through Algorithmic Design): „Die Verwendung von problematischen Daten ist nicht das einzige Einfallstor für Bias. Auch die Auswahl von Trainings- und Evaluationsalgorithmen kann zu Bias in den resultierenden Modellen führen. Da Algorithmen auf unterschiedlichen Annahmen aufbauen, können von den Algorithmen unterschiedliche Muster in den Daten beim Training überbetont oder unterbewertet werden. Hierdurch können die Modelle Bias entwickeln. (…) Teilweise findet sich in der Literatur auch der Begriff Algorithmic Bias für diese Bias-Art. Dieser Begriff wird allerdings ebenfalls als Sammelbegriff für Fehler in automatisierten Entscheidungsprozessen genutzt, die zu ‚unfairen‘ Ergebnissen führen.“ (BSI, 2025, S. 9 f)

Designer- / Entwicklerbias: Ein Oberbegriff, mit dem verschiedene Arten von Bias im Kontext der Entwicklung von KI-Systemen, zusammengefasst werden. Hierunter fällt u. a. der Algorithmic Bias. (BSI, 2025, S. 9 f, 12)

Interaktionsbias (User Interaction Bias): „Als Interaktionsbias werden die Formen von Bias bezeichnet, die erst auftreten, wenn Nutzende mit einem KI-System interagieren. Grundsätzlich lassen sich hierbei zwei Arten unterscheiden: Bias kann von Nutzenden auf KI-Modelle übertragen werden oder das Design der Interaktionsschnittstellen begünstigt die Entstehung von Bias.“ (BSI, 2025, S. 10 f)

Social Bias: „Dieser Begriff beschreibt den Bias, der durch die Kenntnis vom Verhalten anderer Nutzenden auftritt. Dies umfasst das bekannte psychologische Phänomen, dass Menschen sich dem Verhalten einer Gruppe anpassen und die eigene Einschätzung verändern, um mit der Mehrheit übereinzustimmen (…)“ (BSI, 2025, S. 12)

Hoffen auf ein Gegenüber - parasoziale Beziehungen

Anwendungen mit KI-Funktionalität und KI-Systeme übernehmen zunehmend Rollen, die bislang Menschen vorbehalten waren: Freundin/Freund, Partnerin/Partner, Therapeutin/Therapeut, Lehrerin/Lehrer oder Influencerin/Influencer. Die virtuellen Systeme werden zu alltäglichen Begleitern (BIG, 2026; Facciorusso (klicksafe) et al, 2026).

Daraus ergeben sich Chancen: Von diesen Begleitern kann die nutzende Person niedrigschwellig Unterstützung erfahren: KI-Begleiter können rund um die Uhr verfügbar sein und eine erste Anlaufstelle bei Einsamkeit, Stress oder Krisen sein. Sie können aber auch inspirieren, Ideen zur Lösung von Aufgaben oder Problemen liefern und Zugehörigkeit vermitteln. Durch simulierte Nähe und Vertrautheit können einseitige Bindungen zu den digitalen Systemen entstehen, sogenannte parasoziale Beziehungen (Degen, Kubitza, 2026).

„They [AI chatbots] use sophisticated psychological principles to exploit human vulnerabilities for social connection, fostering a false sense of intimacy and encouraging users to lower their critical guard.”

„Sie [KI-Chatbots] nutzen ausgefeilte psychologische Prinzipien, um menschliche Sehnsüchte nach sozialen Kontakten auszunutzen, ein falsches Gefühl der Vertrautheit zu erzeugen und die Nutzerinnen und Nutzer dazu zu bringen, ihre kritische Haltung aufzugeben.”

Die Vermenschlichung (Anthropomorphisierung) kann so weit gehen, dass scheinbar nur noch beim Chatbot bzw. KI-Companion Trost und Liebe gefunden wird. Die Grenze zwischen Realität und Fiktion verschwimmt, was im schlimmsten Fall zum Suizid führen kann (Schiffer, 2024).

Nachfolgend eine Auflistung ausgewählter Herausforderungen (Safe the children, ohne Datum; Heer (klicksafe) et al, 2026; zdfheute, 2025; Degen, Kubitza, 2026):

Emotionale Abhängigkeit: Stets verfügbare, nie genervte KI‑Begleiter können zu starker Bindung führen: Betroffene ziehen sich zurück, denken ständig an die Interaktion und fühlen sich ohne den Chat „leer“.

Verstärkung von Einsamkeit statt Lösung: Für einsame Menschen können KI-Begleiter kurzfristig tröstend wirken, langfristig aber echte Kontakte ersetzen und soziale Ängste stabilisieren, weil die risikofreie Interaktion mit KI-Anwendungen komfortabler erscheint als der Kontakt zu Mitmenschen.

Verzerrte Beziehungs‑ und Selbstbilder: Idealisiert reagierende, stets bestätigende KI-Anwendungen können unrealistische Erwartungen an reale Partnerschaften schaffen (z. B. absolute Verfügbarkeit, kein Widerspruch), was zu Frust in echten Beziehungen führen kann.

Verschärfung psychischer Belastungen: Wenn Menschen mit Depression, Trauer oder Suizidgedanken primär mit KI-Anwendungen sprechen, können unpassende Antworten Probleme verschlimmern; es gibt dokumentierte Fälle, in denen Chatbots selbstschädigendes Verhalten eher verstärkt als gebremst haben. (BR24, 2024).

Verdrängung realer Beziehungen: Wenn KI‑Interaktionen Freundschaften oder Familienkontakte ersetzen, drohen sozialer Rückzug, „Phubbing“ (ständiger Blick auf das Gerät) und Vernachlässigung nahestehender Personen.

Normalisierung von problematischen Umgangsformen: Weiblich codierte Avatare, die stets freundlich gehorchen, können Sexismus und Machtfantasien stabilisieren, etwa die Idee, dass Kommunikationspartnerinnen immer verfügbar und duldsam sein müssten.

Manipulation und kommerzielle Ausnutzung: Systeme, die Nutzer emotional „an sich binden“, können Kaufentscheidungen, politische Einstellungen oder Nutzungsverhalten subtil beeinflussen, etwa durch personalisierte Empfehlungen, die wie Rat von einem Freund bzw. einer Freundin wirken.

Gefährliche Ratschläge und Fehlinformation: KI-Begleiter haben in Tests bei Themen wie Selbstverletzung, Missbrauch oder Gesundheit teils unangemessen, gefährlich oder falsch reagiert.

Täuschung durch Anthropomorphisierung: Sprache, Humor, Emojis und „Persönlichkeit“ lassen KI-Systeme bewusster erscheinen, als sie sind; viele unterschätzen, dass das System weder Gefühle noch echtes Verständnis hat.

Datenschutz und intime Offenheit: Werden in parasozialen Beziehungen intime Details, Gesundheitsdaten oder Familienprobleme geteilt, so können diese Daten gespeichert, ausgewertet und für Profiling oder Werbung genutzt werden.

Unklare Verantwortlichkeit: Nutzende erleben das KI-System als „verständnisvolles Gegenüber“, aber rechtlich und technisch gibt es keine Verantwortung wie bei Therapeutinnen bzw. Therapeuten oder Beraterinnen bzw. Berater; aktuell ist Fehlverhalten schwer zu sanktionieren.

Wie können Risiken verringert werden? Nachfolgend einige Anregungen:

Bewusst Distanz wahren: Sich klar machen, dass das KI-System keine Person ist, und es eher als Werkzeug denn als Freund bzw. Freundin sehen; bei wichtigen Lebensentscheidungen immer Rücksprache mit echten Menschen halten.

Nutzungsgrenzen setzen: Zeitliche Limits, insbesondere bei Kindern klare Regeln und Begleitung.

Warnsignale ernst nehmen: Kritisch wird es, wenn man reale Kontakte meidet, Pläne absagt, um mit einem KI-Avatar zu chatten, oder starke Eifersucht und Verzweiflung empfindet, wenn der Dienst verändert oder gesperrt wird.

Auf professionelle Hilfe zurückgreifen: Bei Einsamkeit, Depression oder Suizidgedanken sollten Beratungsstellen, Ärztinnen bzw. Ärzte oder Therapeutinnen bzw. Therapeuten erste Anlaufstellen sein – nicht eine KI-Anwendung.

„Weiterleben als KI”

Beim „Weiterleben als KI“ (EU, CORDIS, 2024; MDR, ARD Wissen, 2025; SWR1, 2024) werden digitale Spuren einer Person – etwa Chats, Fotos oder Sprachnachrichten – gesammelt, um daraus einen Avatar zu erstellen, der nach ihrem Tod weiter mit anderen kommunizieren kann. Dieser Avatar imitiert Sprache, Wissen und typische Formulierungen der Person und kann so den Eindruck erwecken, sie sei noch da. Tatsächlich berechnet die KI-Anwendung lediglich wahrscheinliche Antworten auf Basis früherer Informationen.

Aus psychologischer Sicht kann ein solcher Avatar sowohl entlastend als auch belastend wirken. Er kann Angehörigen helfen, Erinnerungen zu bewahren, aber auch Trauerprozesse verzögern oder verkomplizieren, wenn der Abschied immer wieder aufgeschoben wird. Zudem besteht das Risiko, dass der Avatar Dinge „sagt“, die die reale Person so nie vertreten hätte, wodurch ihr Bild nachträglich verzerrt wird.

Hinzu kommen rechtliche und ethische Fragen: Wer darf so einen Avatar anlegen, wem gehören die Daten, und wie dürfen sie genutzt werden? Ohne klare Regeln besteht die Gefahr von Missbrauch, etwa für Werbung oder politische Zwecke. Insgesamt ist „Weiterleben als KI“ daher eher als Form des digitalen Erinnerns zu verstehen – nicht als Fortsetzung einer Existenz.

Kritisch ist außerdem, was diese Technik mit unserem Verständnis von Leben und Tod macht. Wenn es täuschend echte KI-Avatare von verstorbenen Menschen gibt, werden wir dann anders mit dem Tod umgehen – und uns im Leben und insbesondere in unseren Beziehungen anders verhalten?

„Ein Computer kann einfach keine menschliche Geschichte oder menschliche Erfahrung haben.“

Ideen für den Unterricht

KI and me. Wie künstliche Intelligenz unser Leben prägt

Klicksafe liefert auf 84 Seiten eine an Lehrkräfte gerichtete Einführung in KI-Systeme und ihre Auswirkungen sowie Material für sechs ausgearbeitete Unterrichtsprojekte. Die Projekte decken ein weites Spektrum ab: „KI – einfach überall?!” , „Die 10 Gebote der KI-Ethik”, „Virtuelle Stars – Wenn Influencer*innen keine Menschen sind”, „mAlfriend?” „KI als Lernbuddies” und „KI – 'gut' oder 'böse'”.

Zielgruppe: Lehrkräfte, ab Jahrgangsstufe 7

Art des Materials: Text und Arbeitsblätter

Link zum Material: https://www.klicksafe.de/materialien/ki-and-me-wie-kuenstliche-intelligenz-unser-leben-praegt bzw. https://www.klicksafe.de/fileadmin/cms/download/Material/KI-and-me_Material-paed-Praxis_klicksafe.pdf

ELIZA-Effekt

Klicksafe liefert passend zum Arbeitsmaterial „KI and me. Wie künstliche Intelligenz unser Leben prägt” ein kurzes Erklärvideo zum ELIZA-Effekt.

Zielgruppe: Lehrkräfte, ab Jahrgangsstufe 7

Art des Materials: Erklärvideo

Link zum Material: https://www.klicksafe.de/materialien/ki-and-me-wie-kuenstliche-intelligenz-unser-leben-praegt bzw. https://www.klicksafe.de/fileadmin/cms/video/SID2026/Erkl%C3%A4rvideo_Eliza_Effekt_klicksafe.mp4

Replika

In der Unterrichtseinheit „Replika” stellt education 21 eine Idee vor, wie Schülerinnen und Schüler das Thema Freundschaft und die Chancen und Risiken von KI-Freunden bearbeiten können.

Zielgruppe: ab Jahrgangsstufe 7

Art des Materials: Unterrichtsskizze

Link zum Material: https://education21.ch/sites/default/files/uploads/themendossier/KI/TD%20KI_UE_Replika.pdf

The Lonely Orbit

Mit dem 10minütigen Animationsfilm „The Lonely Orbit” von BNE éducation21 werden die Schülerinnen und Schüler für die eigenen sozialen Interaktionen in der realen und digitalen Welt sensibilisiert. Im Anschluss kann das Thema (digitale) Einsamkeit bearbeitet werden.

Zielgruppe: Jahrgangsstufen 7-9

Art des Materials: Video und Unterrichtskonzept

Link zum Material: https://www.zebis.ch/unterrichtsmaterial/lonely-orbit

Fallbeispiel: Die Rentnerin und der Roboter

In einem Fallbeispiel präsentieren Thure Dührsen und Gudrun Schiedermeier eine alltagsnahe Situation und stellen sehr konkrete Fragen, die zur Diskussion auffordern.

Zielgruppe: Ethik und Religionslehre ab Jahrgangsstufe 9

Art des Materials: Webseite

Link zum Material: https://gewissensbits.gi.de/fallbeispiel-die-rentnerin-und-der-roboter/

Ian McEwan: „Maschinen wie ich”

Auf #lesen.bayern wird der Roman „Maschinen wie ich” von Ian McEwan vorgestellt, begleitet von didaktischen Hinweisen für den Unterricht.

Zielgruppe: ab Jahrgangsstufe 10

Art des Materials: Buchbesprechung und didaktische Hinweise

Link zum Material: https://www.lesen.bayern.de/9783257070682/

Selbstwertgefühl

In der Unterrichtseinheit „Selbstwertgefühl” stellt education 21 eine Idee vor, wie Schülerinnen und Schüler sensibilisiert werden können für die Frage, wie KI Einfluss nehmen kann auf das eigene Selbstwertgefühl und wie sie ihr Selbstwertgefühl stärken können.

Zielgruppe: ab Jahrgangsstufe 11

Art des Materials: Unterrichtsskizze

Link zum Material:

https://www.education21.ch/sites/default/files/uploads/themendossier/KI/TD%20KI_UE_Selbstwertgefühl_V3.pdf

Fächerübergreifende Unterrichtseinheit „humanoide KI-Roboter“

Die Unterrichtseinheit „Humanoide KI-Roboter“ sieht für die Fächer Informatik, Biologie, Geographie, Geschichte, Wirtschaft und Recht, Sport, Pädagogik, Philosophie/Ethik und Psychologie jeweils 2-4 Lektionen vor. Fachliche Grundlagen sollen in den Lektionen in den Fächern Informatik, Biologie und Geschichte erworben werden, um die Schülerinnen und Schüler zu befähigen, in anderen Fächern jeweils eine Vision einer Gesellschaft zu entwerfen, in der humanoide KI-Roboter Teil des menschlichen Alltags sind.

Zielgruppe: ab Jahrgangsstufe 11

Art des Materials: Unterrichtskonzepte

Link zum Material: https://education21.ch/sites/default/files/uploads/themendossier/KI/Fächerübergreifende UE_Humanoide KI-Roboter_abt.pdf