KI | Wie künstliche Intelligenz unser Zusammenleben und unsere Kultur verändert

Welche Folgen kann der Einsatz von KI für uns alle haben? Welche Chancen, aber auch Risiken ergeben sich damit und wie wollen wir damit umgehen?

Es gibt kaum ein Thema, das in den letzten Jahren eine solche Relevanz in allen Lebensbereichen entwickelt hat wie die Künstliche Intelligenz. Erfahren Sie hier, was genau hinter der Künstlichen Intelligenz und hinter schwacher und starker KI steckt.

Vielleicht ist Ihre persönliche Vorstellung von KI geprägt durch Filme wie „Terminator” (1984), in dem KI als übermächtiger Roboter dargestellt wird, der ein eigenes Bewusstsein entwickelt hat und versucht, die Weltherrschaft zu übernehmen. Auch in „2001: A Space Odyssey“ (1968), entwickelt das KI-System HAL ein eigenes Bewusstsein und tritt in Konflikt mit seinen menschlichen Astronauten.

Diese und andere Filme greifen die dystopischen Vorstellungen und Ängste auf, die mit KI verbunden sind und prägen sie mit. Sie haben gemeinsam, dass sie KI als Roboter bzw. Software darstellen, die menschliche Fähigkeiten in fast allen Punkten erreichen oder gar übersteigen. Man spricht von starker KI (Zweig, 2019, S. 318).

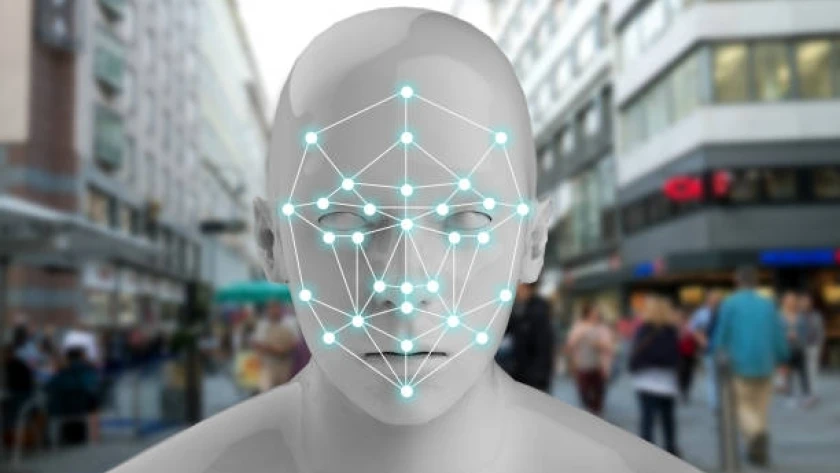

Im Gegensatz dazu wird eine Software, die eine bisher für spezifisch menschlich gehaltene kognitive Einzelfähigkeit ersetzen kann, als schwache KI bezeichnet (Zweig, 2019, S. 318). Beispiele hierfür sind Schachcomputer, Gesichtserkennung und Textproduktion.

Allgemeiner nennen Philosophen „die Behauptung, dass Maschinen agieren könnten, als ob sie intelligent wären, [...] die schwache KI-Hypothese, und die Behauptung, dass Maschinen, die das tun, wirklich denken (und nicht einfach Denken simulieren) die starke KI-Hypothese” (Russell, Norvig, 2012, S. 1176).

Die KI-Technologie scheint derzeit weit von der Etablierung einer starken KI entfernt. KI-Forscher entwickeln aktuell vielmehr KI-Systeme für gewisse, eng umgrenzte Aufgabengebiete, in denen diese Systeme einzelne, bisher für spezifisch menschlich gehaltene kognitive Fähigkeiten ersetzen (Diethelm, 2021).

Ob es jemals in Zukunft Systeme mit starker KI geben wird, ist eine offene Frage, wobei viele Experten davon ausgehen, dass dies nicht möglich sein wird. „Die meisten KI-Forscher nehmen die schwache KI-Hypothese als gegeben hin und kümmern sich nicht um die starke KI-Hypothese” (Russell, Norvig, 2012, S. 1176). Zudem nimmt man an, dass allgemeine Intelligenz einen eigenen Willen und (Selbst-)Bewusstsein voraussetzt.

Zu einer anderen Einschätzung kommt u.a. der US-amerikanische Autor Raymond Kurzweil (*1948) sagt, dass schon in naher Zukunft (bei ihm 2045) die „technologische Singularität“ eintrete, bei der Computer Menschen überlegen seien, sich selbst verbessern und weiter entwickeln können und damit unkontrollierbar werden (Kurzweil, 2018).

Die KI-Forscher Stuart J. Russell and Peter Norvig wiesen darauf hin, dass eine derart mächtige Maschine auch zum Schluss kommen könnte, dass das Fortbestehen der Menschheit nicht erstrebenswert ist: „Wenn wir andererseits heute einen KI-Agenten bauen und ihn anweisen, seine Nutzenfunktion herauszubilden, wie lässt sich dann gewährleisten, dass er nicht zu folgendem Schluss kommt: 'Menschen finden es moralisch, lästige Insekten zu töten, zum Teil weil Insektengehirne so primitiv sind. Da aber Menschengehirne im Vergleich zu meinen Leistungen primitiv sind, muss es für mich moralisch sein, Menschen zu töten.'" (Russell, Norvig, 2012, S. 1198).

Transhumanisten glauben, dass die Menschheit selbst Ausgangspunkt für eine beschleunigte Entwicklung in diese Richtung sein wird und dass diese Entwicklung unabwendbar ist.

Die große Chance der KI-Technologien liegt zudem auch darin, dass sie den Menschen dort unterstützen kann, wo seine Fähigkeiten eingeschränkt sind, z. B. durch KI-Prothesen oder Erkennen von Krankheiten durch die Auswertung von Gesichtsausdruck oder Sprache.

Durch die Auswertung von Mimik und Sprache durch KI können Depressionen frühzeitig erkannt und behandelt werden.

Forscher haben eine App entwickelt, die anhand von Stimmmerkmalen erkennen soll, ob eine Person Covid-19 hat.

AlphaFold entschlüsselt die Form von Proteinen, damit lassen sich Krankheiten bekämpfen und neue Medikamente entwickeln.

KI-Prothesen sind Prothesen, die von der tragenden Person trainiert werden und so immer besser durch Nerven gesteuert werden können.

Zum Weiterlesen:

Sollen Chancen entwickelt und Risiken kontrollierbar bleiben, muss ein regulatorischer Rahmen geschaffen werden, in dem Forschende, Entwicklerinnen und Entwickler, Hersteller, Betreiber und Nutzende agieren können und müssen.

Vertiefende Informationen erhalten Sie nachfolgend:

Welche Folgen kann der Einsatz von KI für uns alle haben? Welche Chancen, aber auch Risiken ergeben sich damit und wie wollen wir damit umgehen?

Erfahren Sie mehr über das Potenzial starker Künstlicher Intelligenz (KI), die ähnlich einem menschlichen Gehirn eigenständig denken und lernen kann.

In der Wissenschaft gibt es keine einheitliche Auffassung davon, wie KI zu definieren ist (Mosch et al., 2021). Eine gängige Vorstellung von KI ist, dass es sich um Systeme handelt, die in der Lage sind, Aufgaben auszuführen, die normalerweise menschliche Intelligenz erfordern.

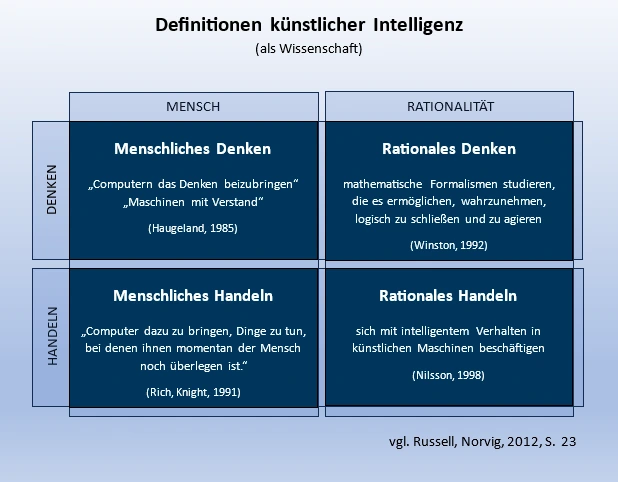

Stuart Russell und Peter Norvig gehen in ihrem Standardwerk zur Künstlichen Intelligenz der Frage nach, was KI ist. Sie rechnen KI zu den neueren Gebieten in Wissenschaft und Technik (Russell, Norvig, 2012, S. 22). Man zählt KI auch zu einem Teilgebiet der Informatik mit vielen interdisziplinären Bezügen. Russell und Norvig versuchen die gemeinsamen Dimensionen der unterschiedlichen Definitionen von KI zu erfassen, indem sie diese in vier Kategorien einteilen (Russell, Norvig, 2012, S. 22 ff). Diese sind in dem folgenden Schaubild dargestellt, das im Weiteren genauer erläutert wird.

Einige Wissenschaftler definieren KI als den Versuch, Computern das menschliche Denken beizubringen. Andere Definitionen rücken das menschliche Handeln in den Vordergrund: KI hat für sie das Ziel, „Computer dazu zu bringen, Dinge zu tun, bei denen ihnen momentan der Mensch noch überlegen ist“ (Rich und Knight, 1991). Diesen Definitionen ist gemein, dass sie als Bezugsgröße zur Messung des Erfolgs eines KI-Systems den Menschen bzw. dessen Intelligenz nehmen.

Der Ansatz, künstliche Intelligenz an menschlicher Intelligenz zu messen ist jedoch nicht unbedingt zielführend. Dies liegt zum einen daran, dass Menschen und Computer grundsätzlich unterschiedliche Fähigkeiten haben: Was einem Computer leicht fällt (wie beispielsweise große Mengen an Zahlen zu verarbeiten oder den Wissensinhalt einer Bibliothek zu speichern) fällt dem Menschen schwer. Was aber für einen Menschen sehr einfach ist (zum Beispiel Bilder zu erkennen oder Tomaten zu pflücken) stellt Computer vor immense Herausforderungen. Zum anderen ist auch der Begriff der menschlichen Intelligenz nicht einheitlich definiert.

Deswegen wählen einige Definitionen eine andere Bezugsgröße zur Messung des Erfolgs eines KI-Systems: die Rationalität. Dieser Begriff ist enger umgrenzt als der der menschlichen Intelligenz. „Ein System ist rational, wenn es das seinen Kenntnissen entsprechende ‚Richtige‘ macht“ (Russell, Norvig, 2012; S. 22), also zum Beispiel gemäß logischer Regeln handelt. So wird KI beispielsweise von Patrick Henry Winston als „Studium der mathematischen Formalismen“ beschrieben, „die es ermöglichen, wahrzunehmen, logisch zu schließen und zu agieren“ (Winston, 1992).

Durch diese vier Bezugsgrößen „menschliche Leistung“ und „Rationalität“ sowie „Denkprozesse/logisches Schließen“ und „Handeln/Verhalten“ ergibt sich das oben illustrierte Raster aus vier Kategorien, welche es ermöglichen, die Vielfalt der unterschiedlichen Definitionen von KI aufzuzeigen und deren Gemeinsamkeiten und Unterschiede besser greifbar zu machen. (Russell, Norvig, 2012).

Lesen Sie im folgenden Beitrag über die KI-Geschichte, welche wichtigen Meilensteine, aber auch Rückschläge die KI im Laufe der letzten Jahrzehnte erfahren hat:

Lesen Sie hier, welche wichtigen Meilensteine aber auch Rückschläge die KI im Laufe der letzten Jahrzehnte erfahren hat.

KI verändert unser Leben rasant und tiefgreifend. Aber kann KI das Leben auf unserem Planeten nachhaltig verbessern?

Wenn Maschinen Augen bekommen: Erfahren Sie in diesem Artikel mehr darüber, wie Bilderkennungstechnologien unser tägliches Leben beeinflussen und welche Auswirkungen dies auf unsere Zukunft haben könnte.

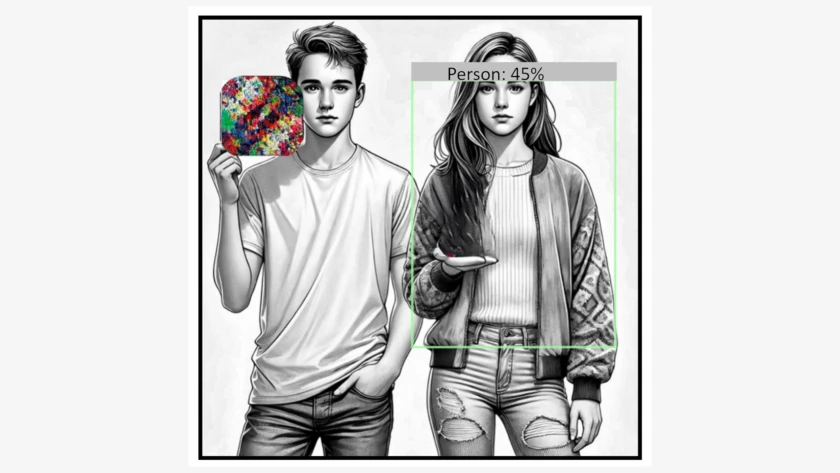

Adversarial Attacks sind faszinierend und beunruhigend zugleich. Durch gezielt manipulierte Eingaben, sogenannte Adversarial Examples, lassen sich Schwachstellen in maschinellen Lernmodellen ausnutzen, um die KI in die Irre zu führen.

Erfahren Sie mehr über das Potenzial starker Künstlicher Intelligenz (KI), die ähnlich einem menschlichen Gehirn eigenständig denken und lernen kann.

Welche Folgen kann der Einsatz von KI für uns alle haben? Welche Chancen, aber auch Risiken ergeben sich damit und wie wollen wir damit umgehen?

Deepfakes, eröffnen eine neue Dimension digitaler Täuschung. Wie können wir dem begegnen?