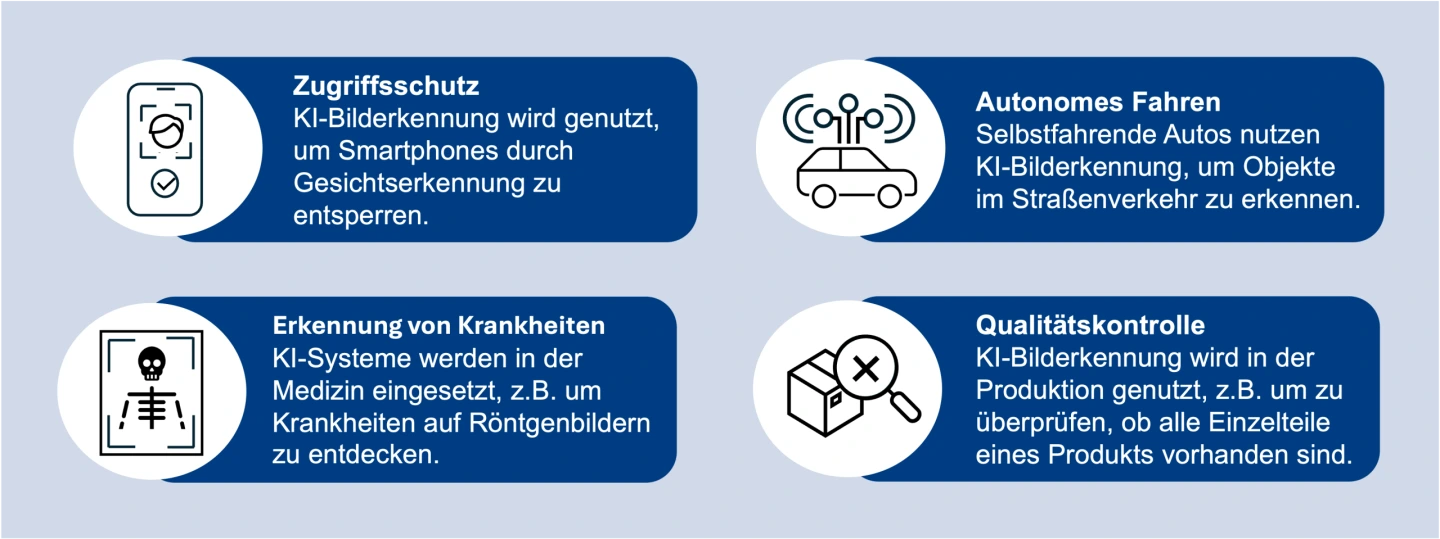

Beispielsweise kann effizient und zuverlässig erkannt werden, ob es Anzeichen für Lungenentzündungen oder Blutungen im Gehirn in einem CT-Bild gibt. Risikofaktoren für schwere Erkrankungen, wie Demenz, können frühzeitig identifiziert werden, um gezielte Vorsorgemaßnahmen oder Therapien anzubieten. KI trägt darüber hinaus dazu bei, personalisierte Therapien zu entwickeln, indem sie Patientendaten nutzt, um die besten Behandlungsoptionen für jeden Einzelnen zu identifizieren (Herrmann et al., 2021).

In einem gesellschaftlich so relevanten und für den einzelnen Bürger so sensiblen Bereich wie der Medizin ist jedoch auch zu bedenken, dass beim Einsatz von KI hohe Datenschutzanforderungen zu berücksichtigen sind, insbesondere bei sensiblen Patientendaten, die an unbefugte Dritte weitergegeben werden können (Brautzsch, 2021). Eine weitere Problematik besteht darin, dass die algorithmischen Auswertungsprozesse KI-basierter Anwendungen in ihrer aktuellen Ausprägung keine Anhaltspunkte dafür liefern, wie ein Ergebnis zustande gekommen ist. Gerade im medizinischen Kontext ist jedoch fundamental wichtig, einen Befund und die damit verbundenen Therapieentscheidungen transparent zu gestalten, denn schließlich tragen immer noch die behandelnden Ärztinnen und Ärzte die Verantwortung – nicht die Algorithmen (Meißner, 2021).

Personalauswahl